微分エントロピー(びぶんエントロピー、英: differential entropy)または連続エントロピー(continuous entropy)は情報理論における概念で、シャノン情報量(確率変数が持つ平均的自己情報量の尺度)を連続型確率分布にまで拡張するクロード・シャノンの試みに端を発する。情報量の概念を連続量まで真に拡張したものに limiting density of discrete points(LDDP)がある。本記事で述べる微分エントロピーは文献でよく目にするものだが、LDDPに制限を加えた特別な場合の一つであり、離散的情報量の持つ基本的な性質のいくつかを失っている。

定義

を、確率密度関数 の関数の台が である確率変数とする。微分エントロピー または は

と定義される。

明示的な確率密度関数は持っていないが、明示的な分位点関数表示 を持っている確率変数(確率分布)に対しては を の微分として定義できる。つまり、分位点密度関数 により

と定義する。

離散型の場合と類似して、微分エントロピーの単位は対数の底に依存する(通常は底を2とし、単位はビットとする)。対数の底による違いについては en:logarithmic units を参照。関連した概念である結合、条件付き、相対微分エントロピーも同様に定義される。

離散的な場合とは異なり、微分エントロピーには の計測単位に依存して横ずれが生じる。例えば、ある量をミリメートルで測ったときの微分エントロピーは、同じ量をメートルで測ったときよりも log(1000) だけ大きな値になる。無次元量の微分エントロピーは、その 1/1000 を計量の基本単位として表示したときの微分エントロピーよりも log(1000) だけ大きな値になる。

確率密度関数は1を超える値をとり得るから、離散的なエントロピーの性質を微分エントロピーにも適用するときは注意を要する。例えば、一様分布 は負の微分エントロピー

を持つ。

一方で相互情報量 は、連続量に対しても2情報の依存度合の尺度として基本的に重要である。この量は実質的に、離散的な と にそれぞれ「分割(partition)」を施していき、分割幅を限りなく細かくしていったときの極限に相当するからである。 は と を線形な位相同型(自身および逆が連続である写像)で変換しても不変であるばかりでなく非線形同型写像による変換の下でも不変である。相互情報量は、空間的に連続的な値を許すような伝送を介する状況下での2情報量の関係を表現することができる。

離散的なエントロピーが持つ性質の微分エントロピーへの拡張については en:limiting density of discrete points を参照。

微分エントロピーの性質

- 確率密度関数 と に対しカルバック・ライブラー情報量 は 0 以上であり、0 と一致するのはほとんど至るところで であるとき、かつそのときに限る。同様に、2つの確率変数 と に対し かつ で、等号が成立するのは と が独立であるとき、かつそのときに限る。

- 離散型の場合と同じく連鎖律が成り立つ。

- 平行移動不変である。つまり任意の定数 に対し

- 特に、定数 に対しては

- ベクトル値確率変数 と可逆な正方行列 に対しては

- 一般に、あるベクトル値確率変数から同じ次元のベクトル値確率変数への変換 があるとき、対応するエントロピーは

- を満たす。ここで は変換 のヤコビ行列式である。この不等式は変換が全単射のとき等式になる。さらに が回転、平行移動、またはそれらの合成であるとき、ヤコビ行列式の値は常に1であり、 となる。

- 確率変数ベクトル の平均が0で分散共分散行列が のとき

- 等号が成立するのは が多変量正規分布に従うとき、かつそのときに限る。

しかし、微分エントロピーは他のいくつかの望ましい性質を持っていない:

- 微分エントロピーは変数変換の下で不変でない。最も有用になるのは変量が無次元の場合である。

- 微分エントロピーは負になり得る。

これらの欠点に対応するため微分エントロピーを修正したものが relative information entropy であり、これは不変測度因子を含んでいる。en:limiting density of discrete points を参照。

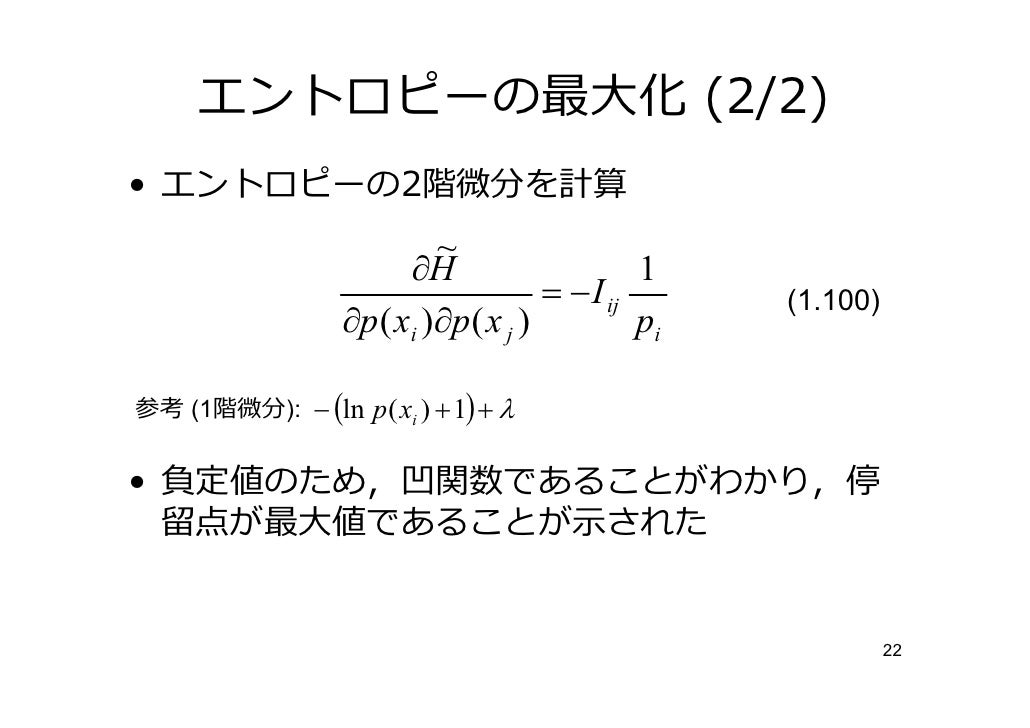

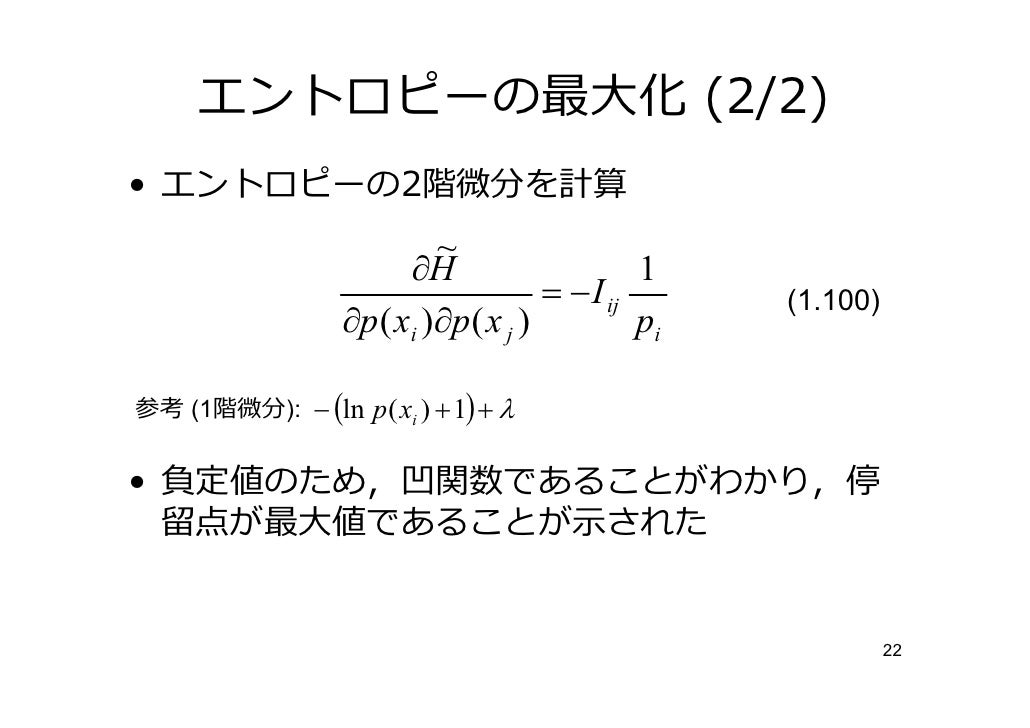

正規分布のときに最大になること

定理

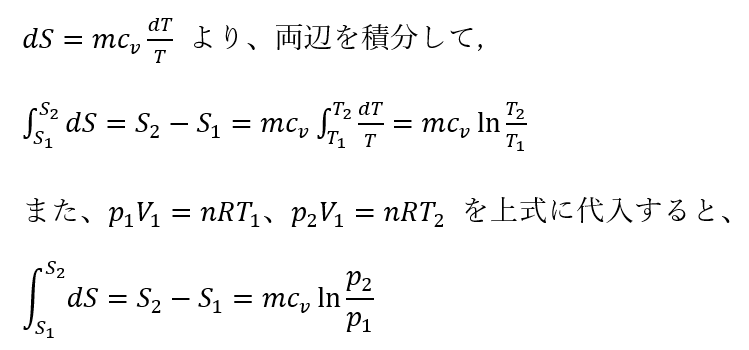

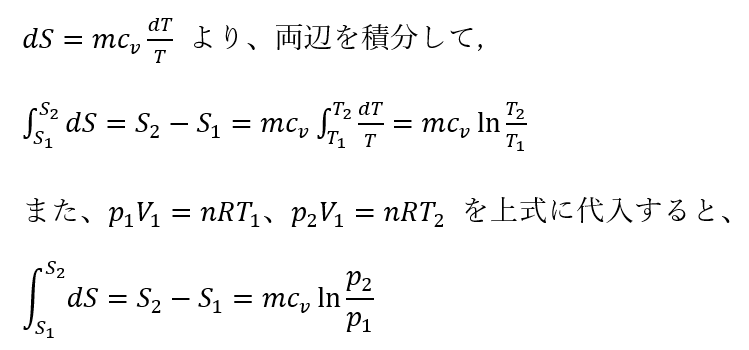

平均 , 分散 が固定されたとき、微分エントロピーが最大になるのは分布が正規分布のときである。

証明

を平均 ・分散 の正規分布の確率密度関数とし、 を同一の平均と分散を持つ任意の確率密度関数とする。

2分布間のカルバック・ライブラー情報量

を考える。ここで

である。よって 。

例:指数分布

がパラメータ の指数分布に従う、つまり確率密度関数が

であるとする。この微分エントロピーは

ここで、計算の簡易化のため対数の底を e としていることを明示するため、 ではなく と書いている。

推定誤差との関係

微分エントロピーは推定量の平均二乗誤差に対する、一つの下限を与える。任意の連続型確率変数 とその推定統計量 に対し、以下が成り立つ:

等号が成立するのは が正規分布に従い、 が の平均であるとき、かつそのときに限る。

様々な分布の微分エントロピー

下記の表で、 はガンマ関数、 はディガンマ関数、 はベータ関数、γE は オイラーの定数である。

これらの多くについては脚注参照。

関連項目

脚注

外部リンク

- Hazewinkel, Michiel, ed. (2001), “Differential entropy”, Encyclopedia of Mathematics, Springer, ISBN 978-1-55608-010-4, https://www.encyclopediaofmath.org/index.php?title=Differential_entropy

- Differential entropy - PlanetMath.org(英語)